الف. هوشیار

سهشنبه ۸ اردیبهشت ۱۴۰۵

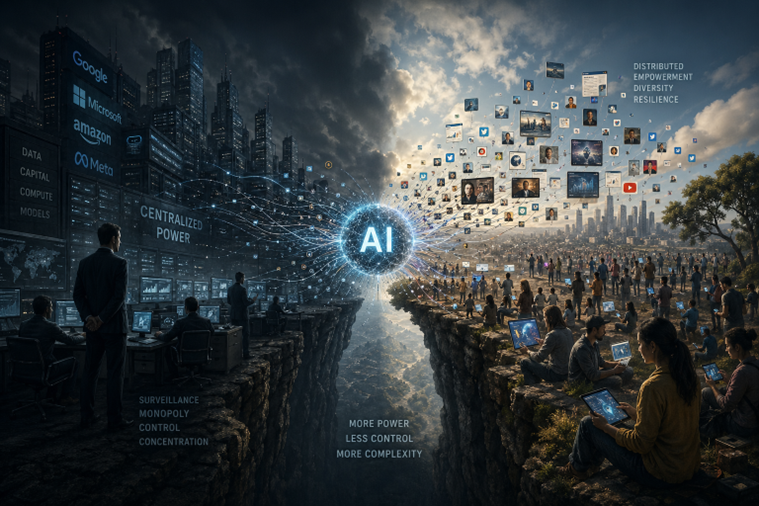

در نگاه اول به نظر میرسد هوش مصنوعی ابزاری برای تمرکز بیسابقهٔ قدرت باشد. اما پارادوکس اصلی در جای دیگری نهفته است: هرچه این فناوری قدرتمندتر میشود، جهانی که در آن عمل میکند پیچیدهتر، متکثرتر، و کمتر قابل کنترل میشود.

در سالهای اخیر بحث دربارهٔ هوش مصنوعی اغلب میان دو قطب در نوسان بوده است. یک روایت بر تمرکز قدرت تأکید میکند، به این معنا که شرکتهای بزرگ فناوری با دسترسی انحصاری به داده، زیرساخت، و سرمایه در حال ساختن نوعی الیگارشی دیجیتالاند. روایت دیگر از دموکراتیک شدن تواناییها میگوید: ابزارهایی که تا دیروز در اختیار صاحبان ثروت و نفوذ و امتیاز بود امروز به دست میلیونها کاربر رسیده است.

هر دو روایت بخشی از حقیقت را میگویند، اما هیچکدام بهتنهایی کافی نیست.

مسئلهٔ واقعی در فاصلهٔ میان این دو قرار دارد: هوش مصنوعی همزمان قدرت را متمرکز و کنش را پراکنده میکند و از برخورد این دو نوعی پیچیدگی پدید میآید که کنترل کردن هوش مصنوعی را برای قدرتهای حاکم دشوارتر میسازد.

از کنترل ریسک به مدیریت پیچیدگی

بخش بزرگی از سیاستگذاریهای کلان در حوزهٔ هوش مصنوعی یا اِ آی (AI) هنوز بر یک فرض ساده استوار است: اینکه میتوان ریسکها را شناسایی و طبقهبندی و مدیریت کرد. اما این فرض بهویژه در مورد سیستمهای پیشرفتهٔ هوش مصنوعی بهطور فزایندهای مورد تردید قرار گرفته است.

پژوهشگری به نام هوگو راجر پاز (Hugo Roger Paz) در مقالهای که در سال ۲۰۲۵ منتشر شد گفت که مشکل اصلی در این است که ما با یک «سیستم پیچیدهٔ خودتطبیقگر» سروکار داریم، نه با یک ابزار منفرد.۱ در چنین سیستمی، آسیبها اغلب نه مستقیم، بلکه از طریق تعاملات غیرخطی، تأخیر زمانی، و حلقههای بازخوردی ظاهر میشوند. به بیان سادهتر: مداخله برای کنترل خودش به بخشی از مسئله تبدیل میشود.

وقتی قانونی برای محدود کردن یک کاربرد وضع میشود، بازیگران به آن واکنش نشان میدهند؛ مدلهای کسبوکار تغییر میکند، کاربران مسیرهای تازهای پیدا میکنند، و فناوری در جهتهای پیشبینینشدهای تکامل مییابد. نتیجه اغلب چیزی متفاوت با آن هدفی است که قانونگذاران انتظار داشتند.

تمرکز در زیرساخت

در عرصهٔ زیرساخت تصویر نسبتاً روشن است. توسعهٔ مدلهای پیشرفتهٔ اِ آی (AI) به منابع عظیمی نیاز دارد: از مراکز داده و پردازندههای گرانقیمت گرفته تا دادههای وسیع و سرمایهگذاریهای چنددهمیلیارددلاری.

گزارش شاخص اِ آی (AI Index) دانشگاه استنفورد نشان میدهد که تولید مدلهای پیشرفتهٔ هوش مصنوعی بهطور فزایندهای در دست یک صنعت متمرکز شده است.۲ سرمایهگذاریها نیز در همین جهت حرکت میکنند: در سال ۲۰۲۴، ایالات متحد آمریکا بیش از ۱۰۰میلیارد دلار در حوزهٔ هوش مصنوعی سرمایهگذاری خصوصی جذب کرد، رقمی که فاصلهٔ آن با سرمایهگذاری کشورهای دیگر چشمگیر است.۳

این تمرکز فقط اقتصادی نیست، بلکه دانشبنیاد و نهادی نیز هست. همان شرکتهایی که مدلها را میسازند استانداردها را هم تعیین میکنند، زیرساختها را هم کنترل میکنند، و قواعد بازی را شکل میدهند و به تسلط بر بازارها میاندیشند.

پراکندگی در کنش

اما این فقط نیمی از داستان است. همان فناوریهایی که در مراکز دادهٔ عظیم ساخته میشوند وقتی وارد زندگی روزمره میشوند، تواناییهایی را به میان کاربران میبرند که پیشتر در انحصار نهادهای بزرگ بود. اگرچه این تواناییها محدود به نظر می رسد، اما وقتی میلیاردها انسان آن را در کاربردهای متعدد، آنهم در سیستمهای پیچیدهٔ اقتصادی اجتماعی در سطح جهان به کار میگیرند، حیرتانگیز خواهد بود.

برای مثال، روزنامهنگاران مستقل میتوانند سریعتر تحقیق کنند. فعالان مدنی میتوانند پیامهایشان را با کیفیتی حرفهیی تولید کنند. دانشجویان به ابزارهای تحلیلی پیشرفته دسترسی دارند. حتی در بازارهای مالی، سرمایهگذاران خُرد به ابزارهایی مجهز شدهاند که پیشتر فقط در اختیار مؤسسات بزرگ بود.

مطالعات اخیر نشان میدهد که هوش مصنوعی مولد حتی ساختار صنایع خلاق را نیز تغییر داده و هزینهٔ تولید محتوا را بسیار کاهش داده است.۳

نتیجه این است: تولید فناوری متمرکز است، اما استفاده از آن پراکندگی بسیار متنوعی پیدا کرده است.

رسانهها: انفجار روایتها

در حوزهٔ رسانه این پارادوکس بهوضوح دیده میشود. از یک سو، ابزارهای اِ آی (AI) امکان تولید و توزیع گستردهٔ محتوا را به بازیگران بزرگ میدهد. از سوی دیگر، همین ابزارها به کاربران کوچکتر نیز قدرت میدهد که وارد میدان شوند و روایتهای بازیگران بزرگتر را به چالش بکشند. نتیجه نه کنترل بیشتر، بلکه انفجار روایتها است.

در چنین فضایی، هر تلاش برای تثبیت یک روایت با موجی از باز تفسیرها، ترجمهها، و روایتهای جایگزین روبهرو میشود. به این ترتیب، میدان رسانهیی ممکن است بهجای آنکه منظمتر شود، سیالتر و رقابتیتر شود، و چه بسا آشوبی شود.

بازارها: عقلانیت فردی، آشوب جمعی

در بازارهای مالی وضع حتی از این هم پیچیدهتر است. اگر ابزارهای اِ آی (AI) به سرمایهگذاران کمک میکنند که تصمیمهای بهتری بگیرند، پس انتظار میرود بازارها کاراتر شوند. اما وقتی تعداد زیادی از بازیگران با ابزارهای مشابه به نشانههای مشابه واکنش نشان دهند، نتیجه میتواند نوسانهای شدید و رفتارهای پیشبینینشدنی در بازار باشد. در اینجا هوش مصنوعی نهفقط تحلیلگر بازار، بلکه بخشی از خودِ بازار میشود.

حکمرانی در جهانی غیرخطی

این تحولات چالشهایی جدّی برای حکمرانی ایجاد میکند. مطالعات اخیر در حوزهٔ سیاستگذاری نشان میدهد که رویکردهای سنّتی- مبتنی بر مسئولیتپذیری خطی و کنترل مستقیم- برای مدیریت سیستمهای اِ آی (AI) کافی نیستند.۵ در عوض، این ایده مطرح شده که به رویکردهایی نیاز است که با پویایی، عدمقطعیت، و رفتارهای نوظهور کنار بیایند.

دموکراسی: فراتر از اخبار جعلی

در بحث افول دموکراسی نیز تمرکز بیش از حد بر «خبرهای جعلی» ممکن است ما را از مسئلهٔ اصلی منحرف کند. برخی پژوهشها نشان میدهد که خطر واقعیتر در تغییر ساختار ارتباط سیاسی است.۶ وقتی تولید پیامهای سیاسی بهطور گستردهای خودکار میشود و ارتباط با رأیدهندگان به هدفگیری دادهمحور وابسته میشود، رابطهٔ نمایندگی دگرگون میشود. در این حالت، حتی اگر ظاهر لیبرال دموکراسی مبتنی بر نمایندگی حفظ شود، اساس آن زیر سؤال میرود و معلوم نیست با چه چالشهای اجتماعی تازهای روبهرو شود.

نتیجه: قدرت بیشتر، کنترل کمتر

هوش مصنوعی را نمیتوان صرفاً به مفهوم ابزاری برای تمرکز یا توزیع قدرت فهمید. این فناوری هر دو روند را همزمان تشدید میکند. در عرصهٔ زیرساخت، قدرت متمرکزتر میشود. در عرصهٔ کنش، تواناییها پراکندهتر و عمومیتر میشود. و در عرصهٔ تعامل، سیستمها پیچیدهتر و کمتر قابل پیشبینی میشوند. به همین دلیل، شاید مهمترین ویژگی عصر هوش مصنوعی این باشد: هرچه ابزارها برای کنترل کردن جهان قدرتمندتر میشوند، خودِ جهان کمتر قابل کنترل میشود.

یادداشتها:

1. Hugo Roger Paz, From Linear Risk to Emergent Harm: Complexity as the Missing Core of AI Governance, 2025.

2. Stanford HAI, AI Index Report 2024.

3. Stanford HAI, AI Index Report 2025.

4. Study on generative AI and content production, Journal of Business Research, 2025.

5. Marijn Janssen, Responsible Governance of Generative AI from a Complex Adaptive Systems Perspective, Policy and Society, 2025.

6. “AI’s Real Dangers for Democracy,” Journal of Democracy, 2024/2025.